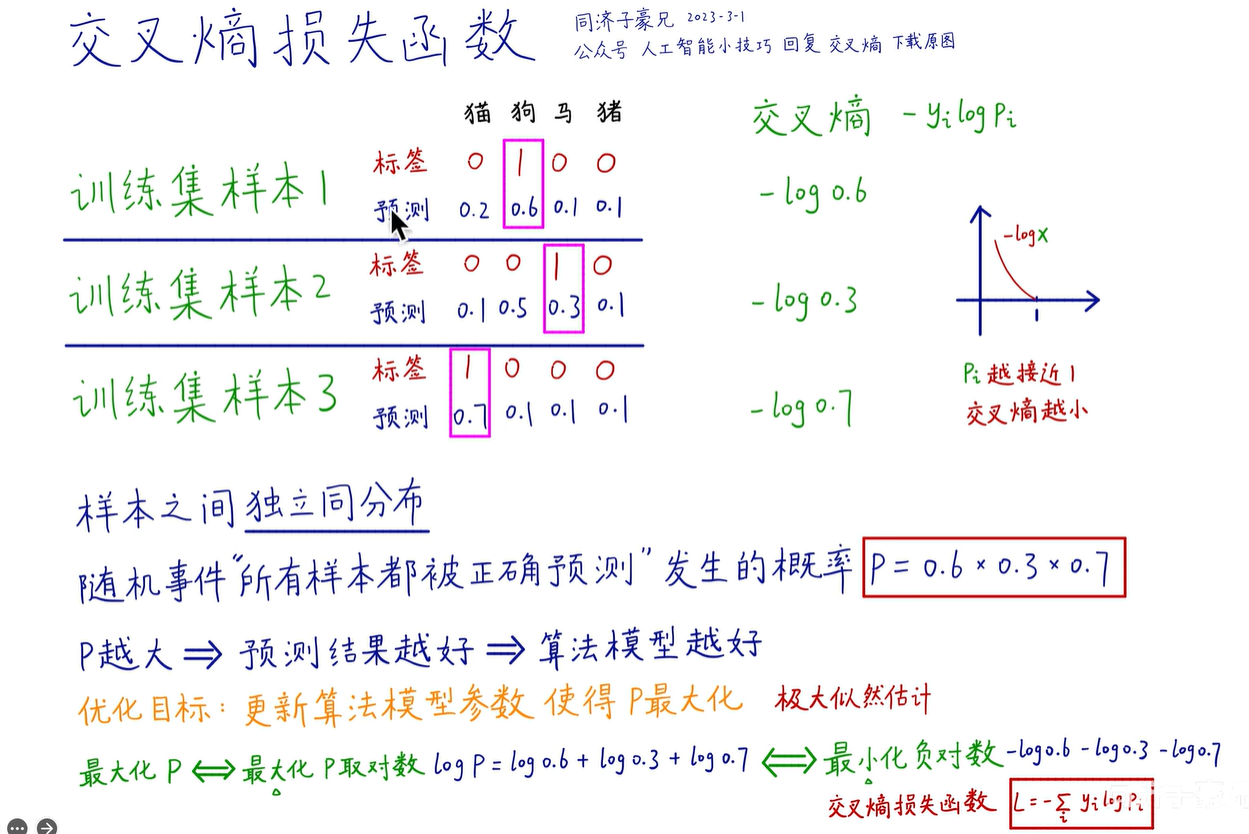

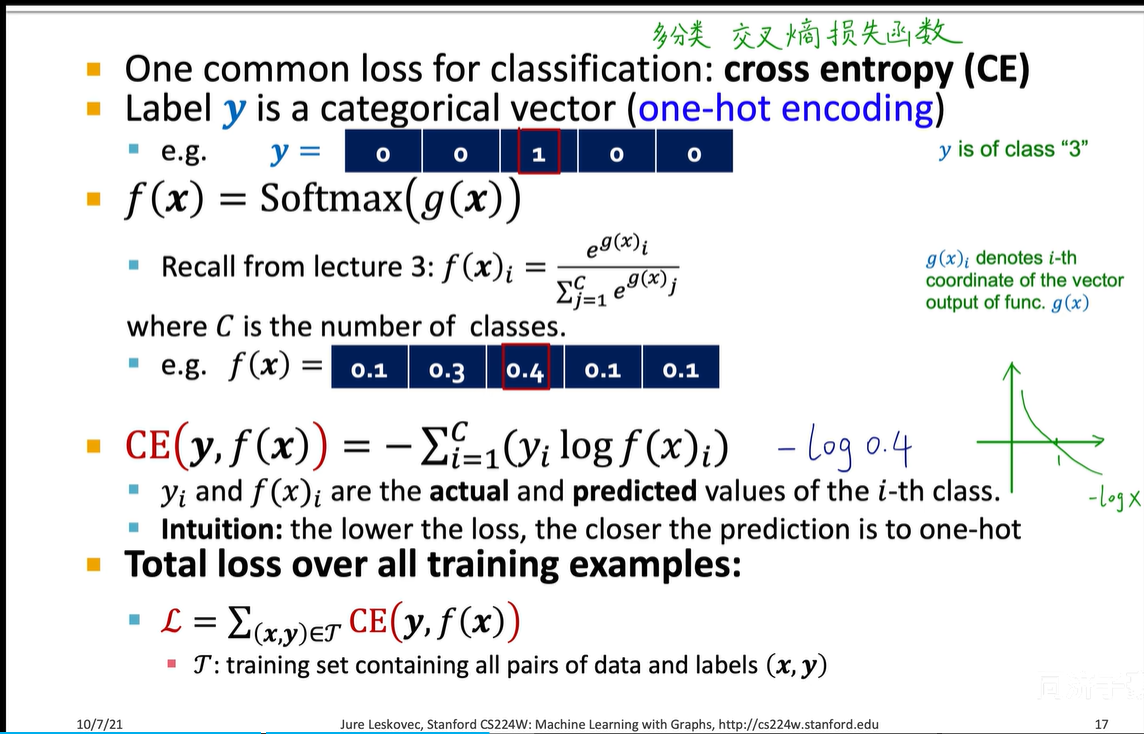

交叉熵损失函数

- 实际上就是判断对的总概率乘积的对数取负号(为了将问题从最大化问题转化为最小化问题)

- 此处在每个交叉熵层之前添加一个softmax,使得输出的概率之和为1

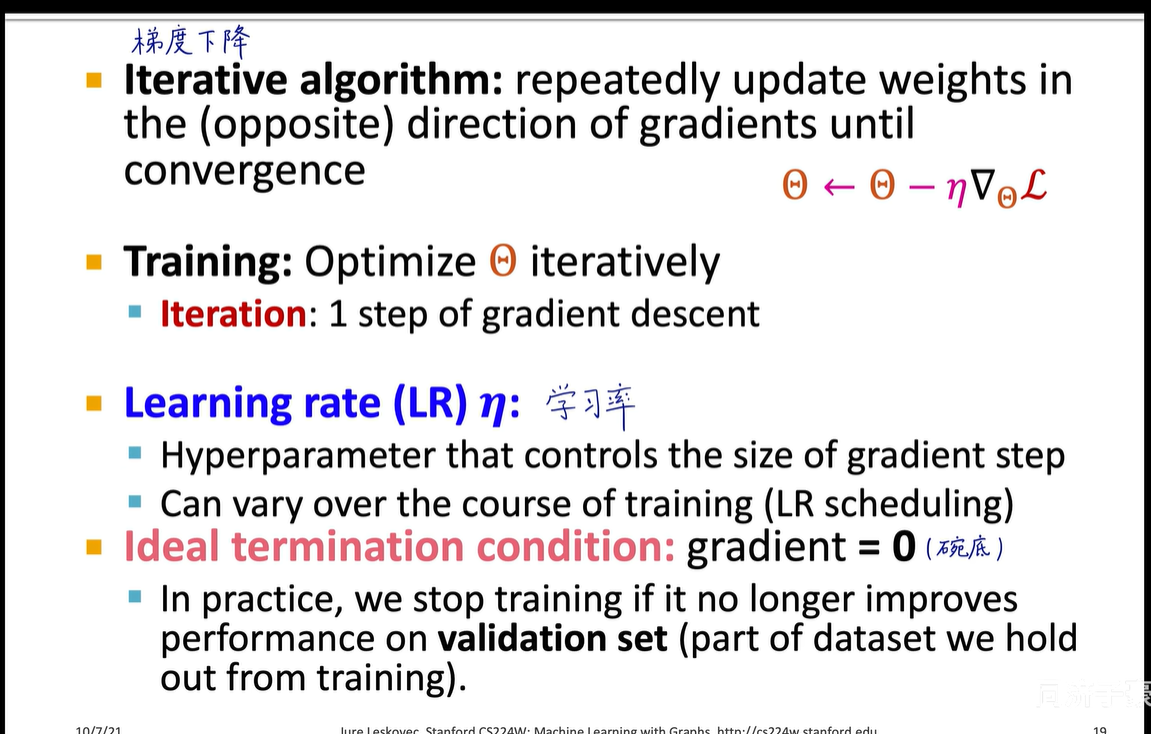

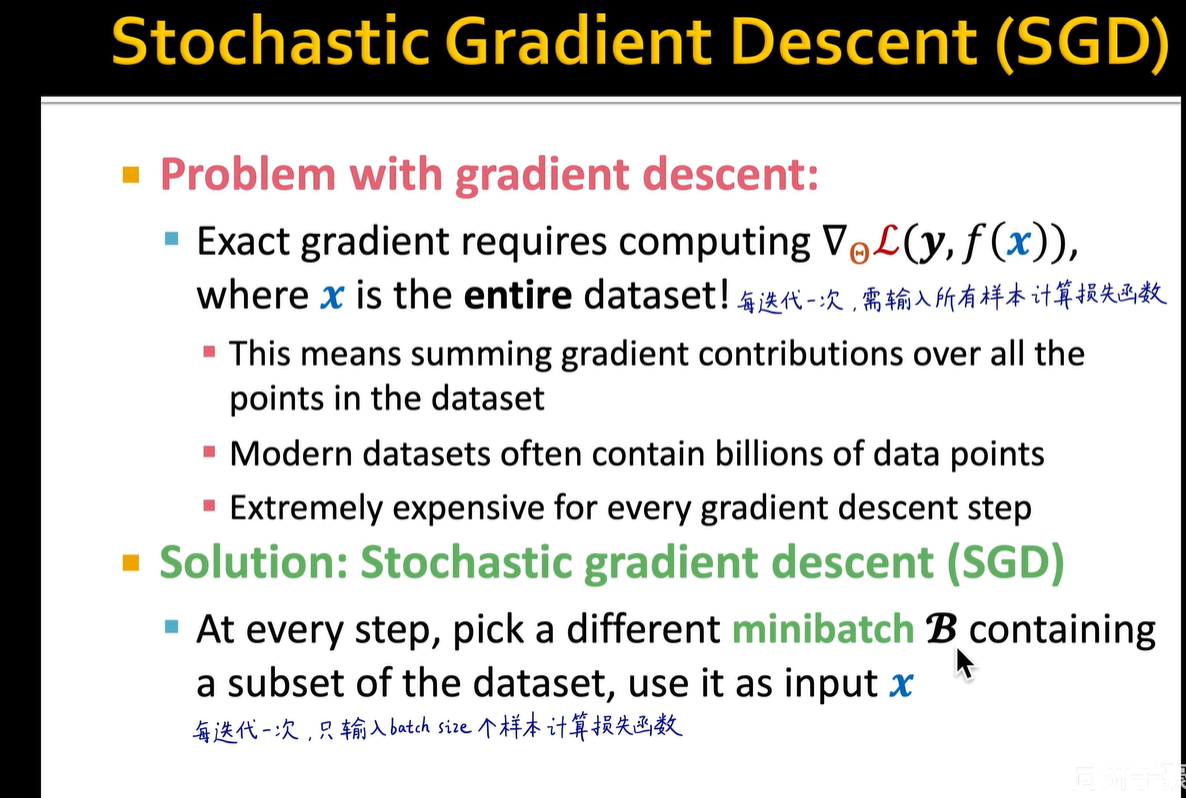

- 一般不会一次下降就将所有数据输入求梯度进行下降, 而是选择

mini- batch多少的数据进行计算,求损失函数并且下降

- 一般不会一次下降就将所有数据输入求梯度进行下降, 而是选择

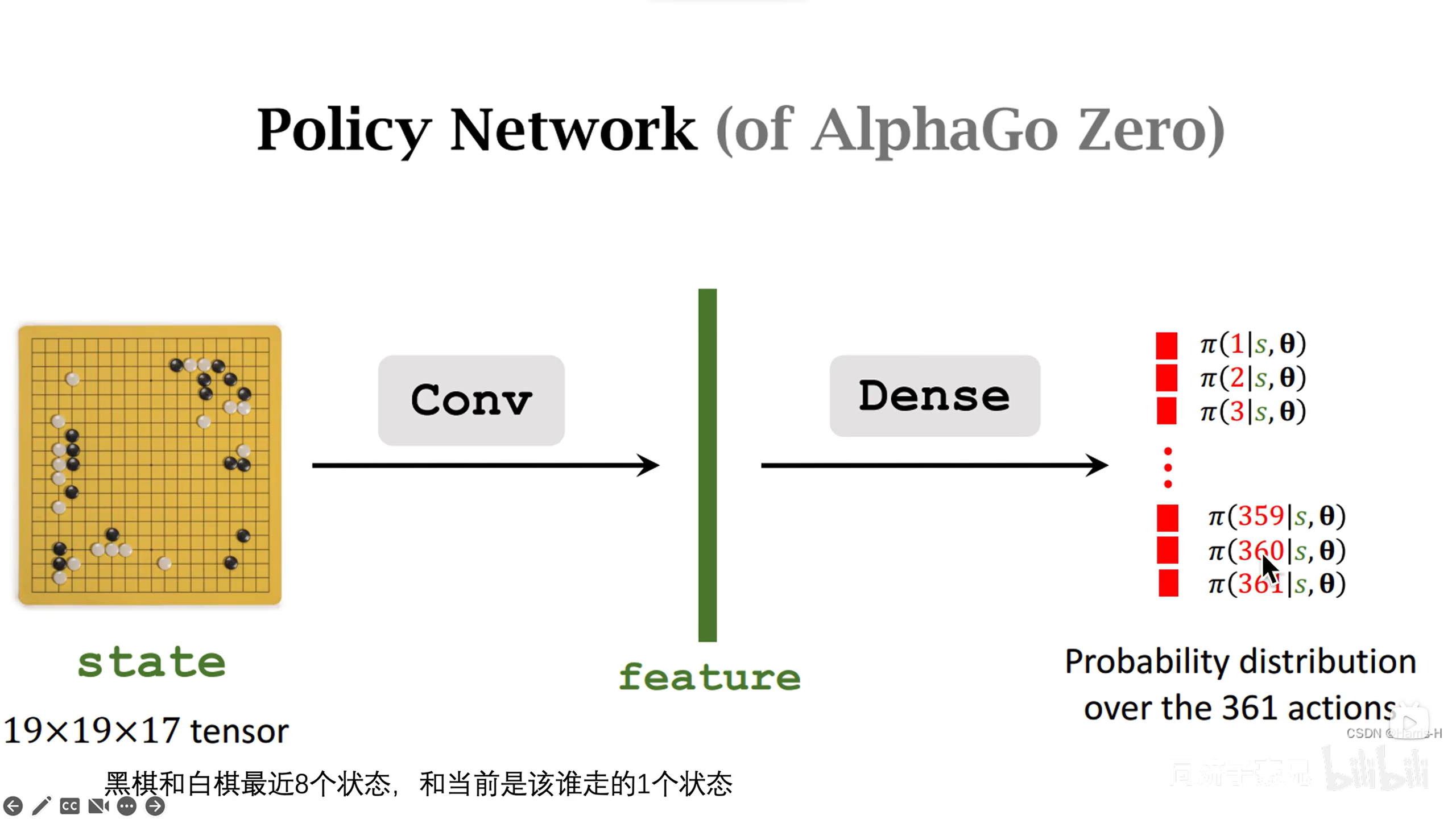

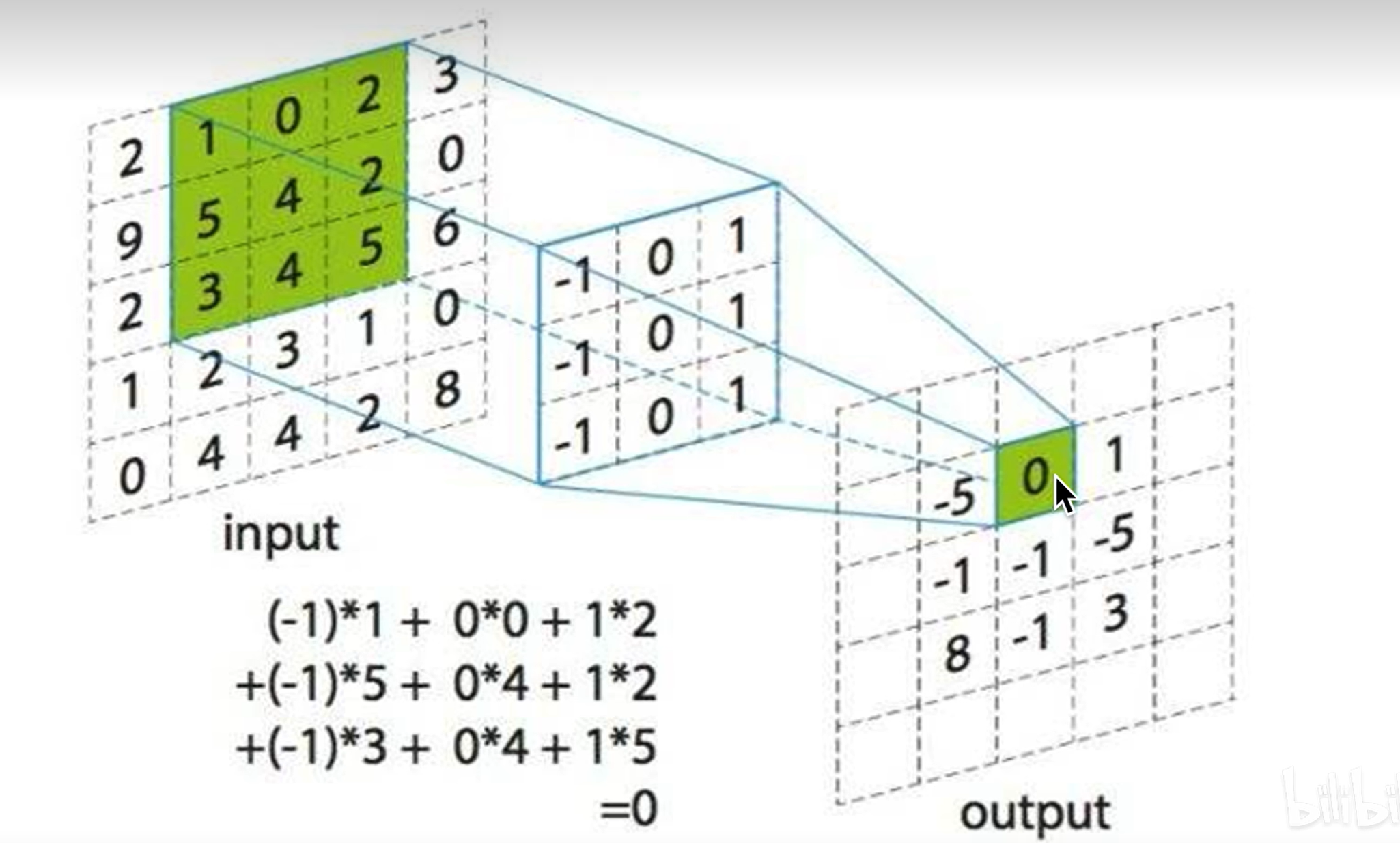

卷积

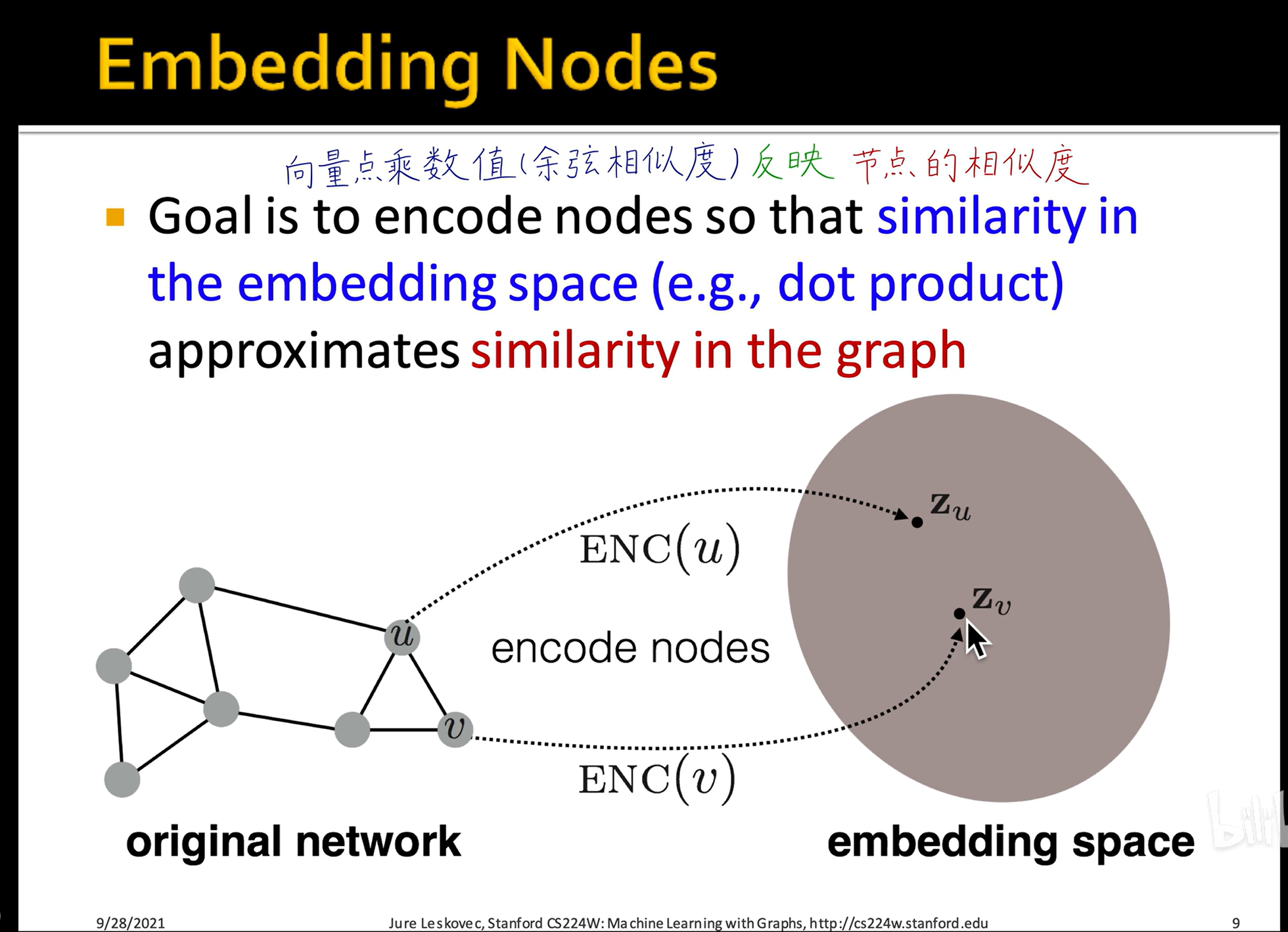

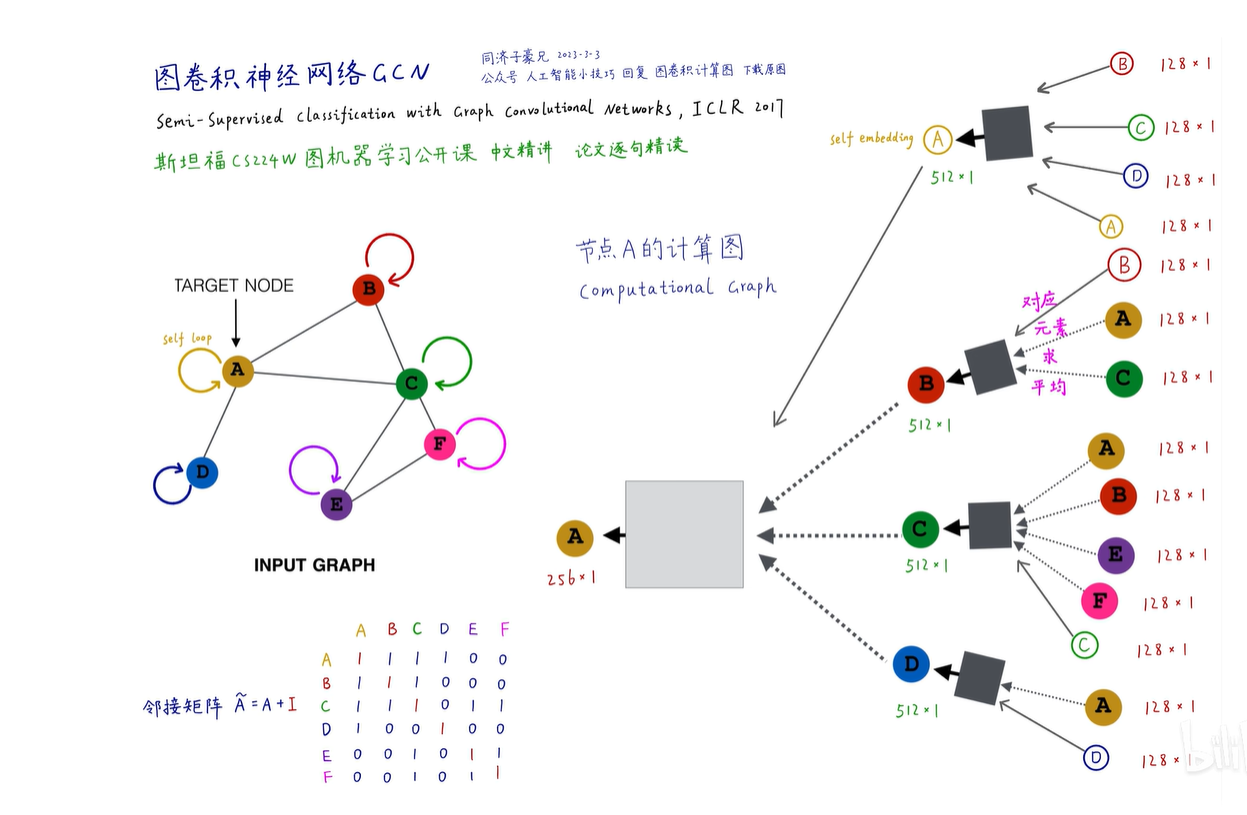

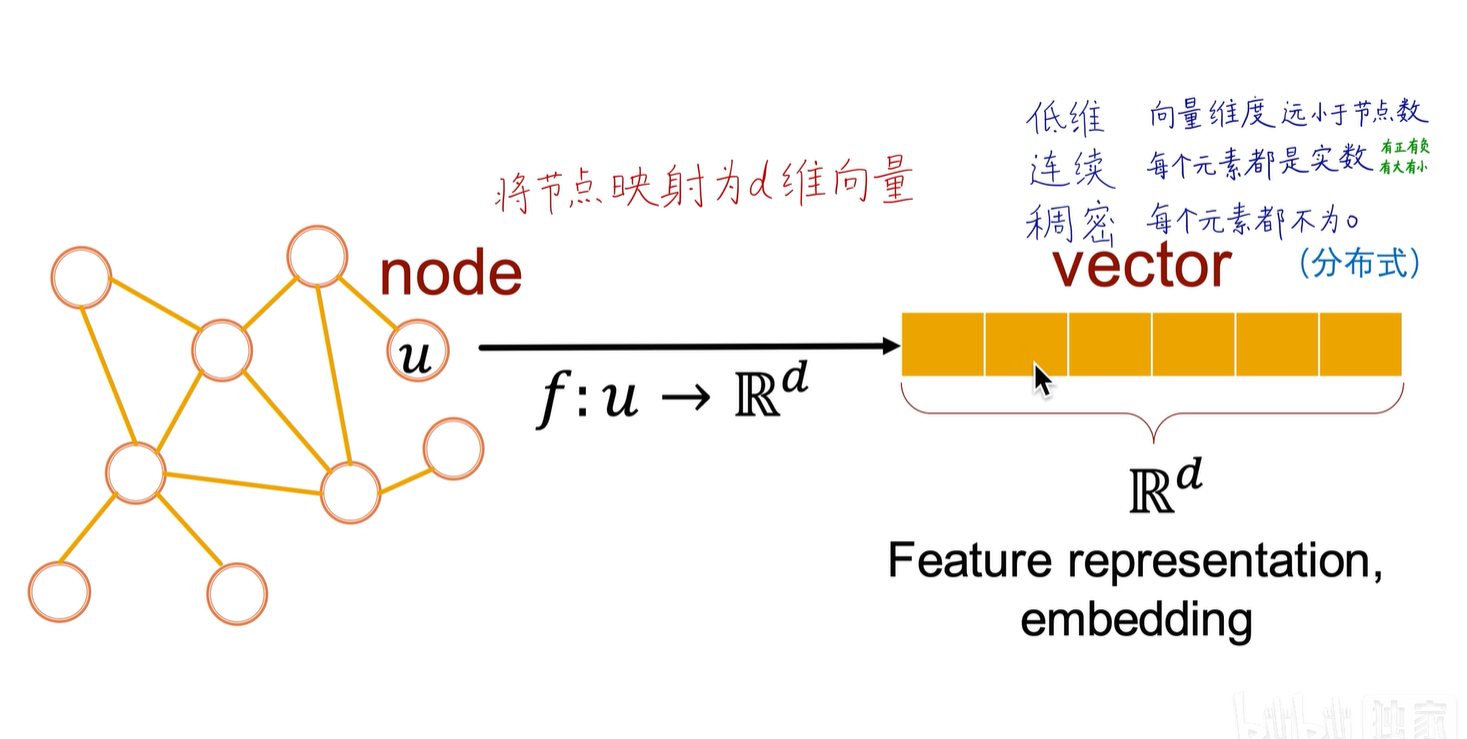

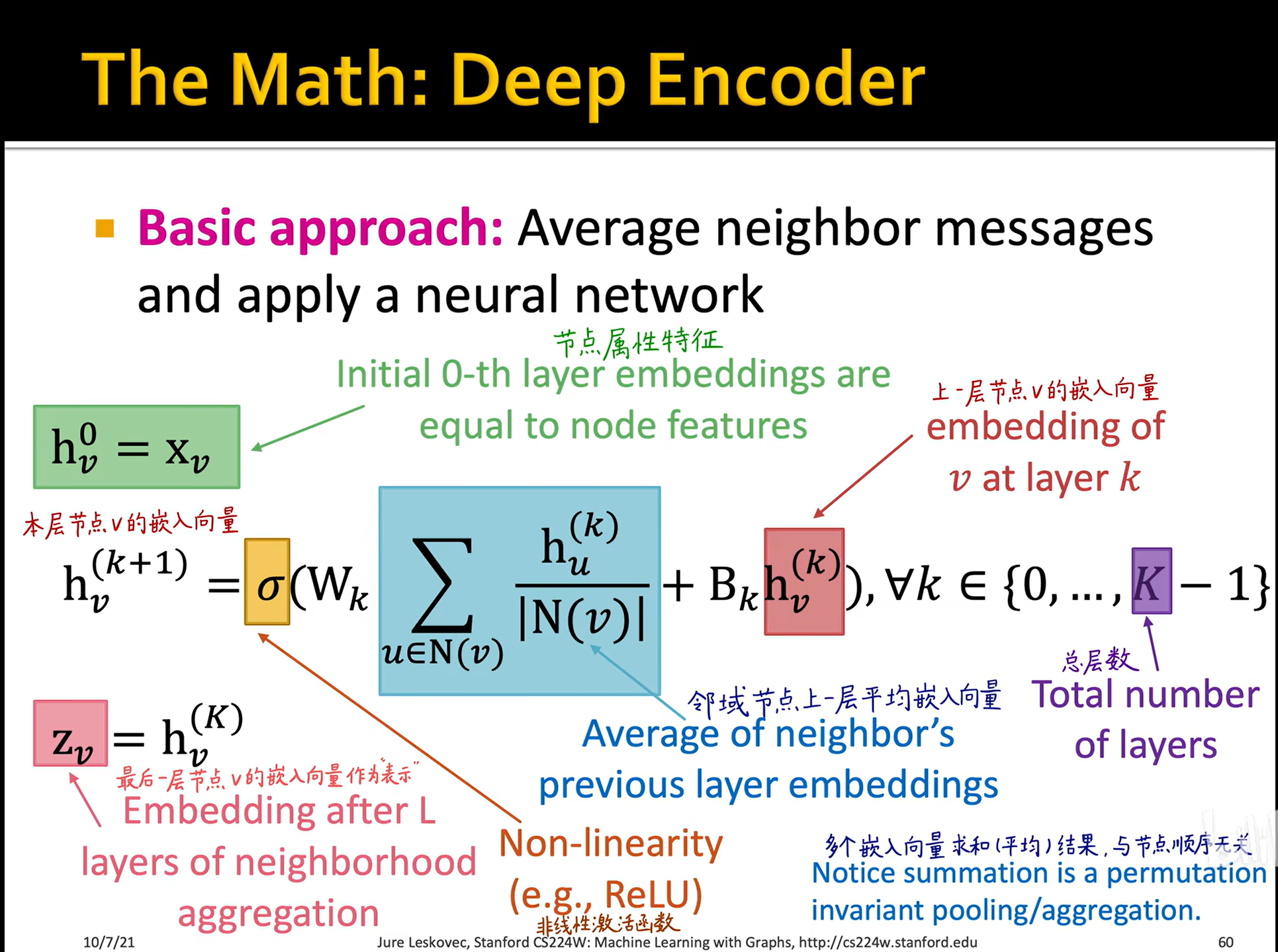

- 本质上是将一个个的节点映射成低维空间中的点(向量),点之间的距离反映关联程度

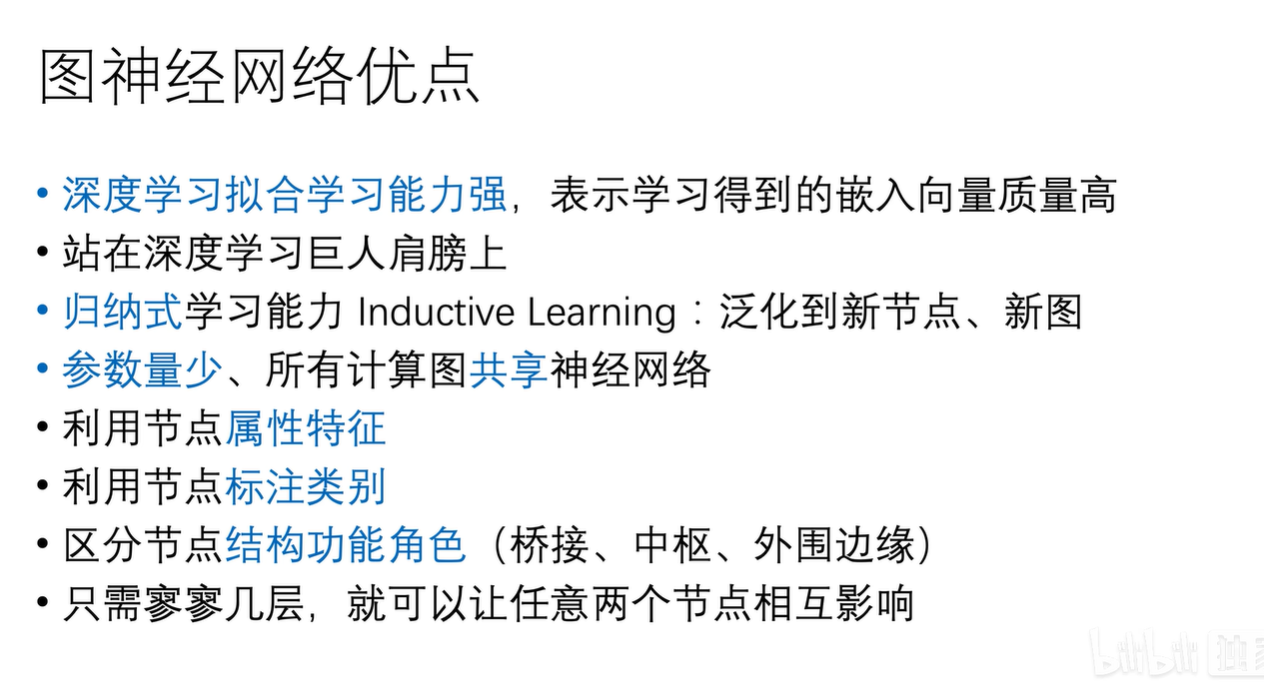

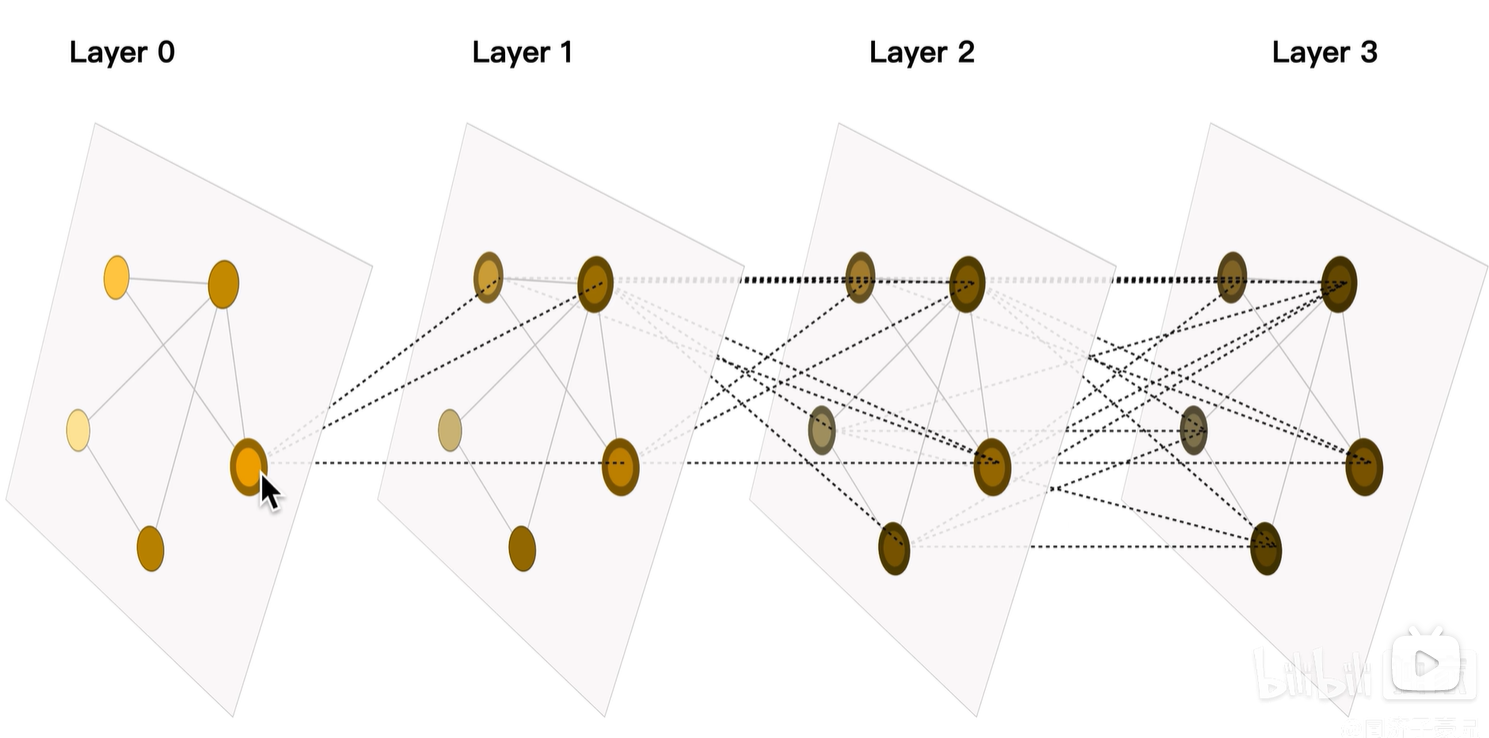

- 图神经网路得层数(不是其中神经网络得层数,而是每个节点的邻居的层数)不能太深,否则所有节点的最终总邻居都差不多,导致所有节点的最终结果都类似,称为过平滑

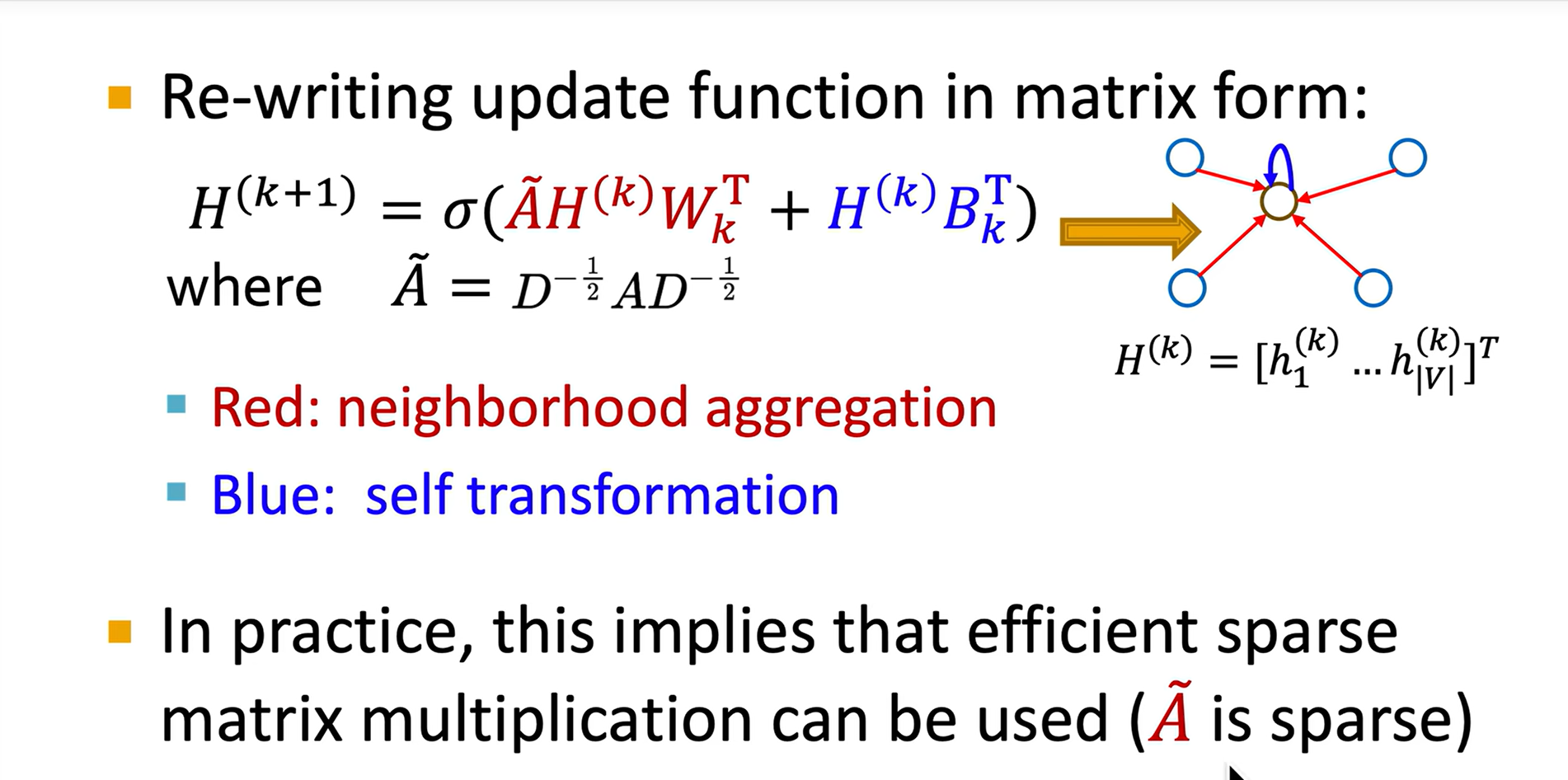

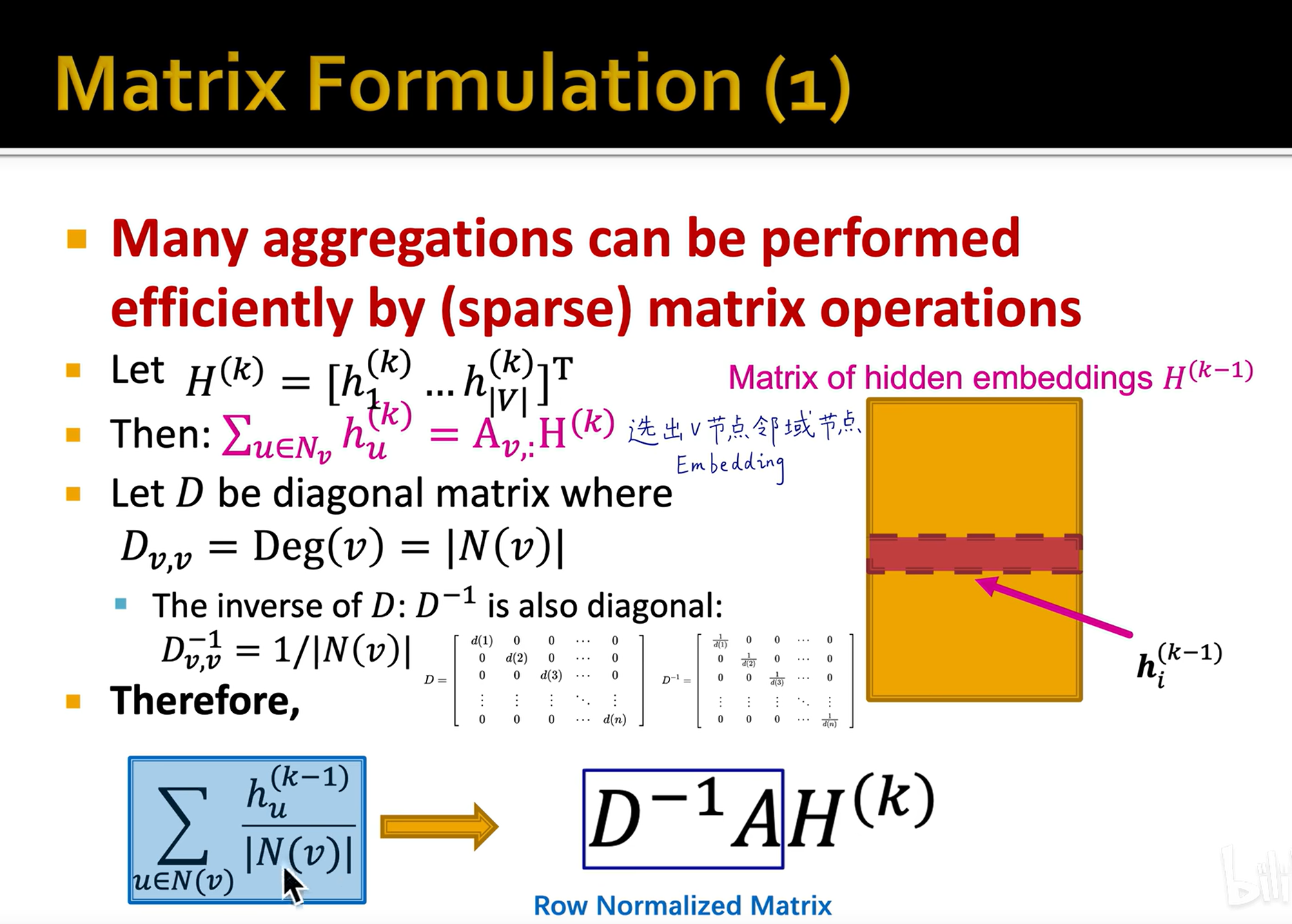

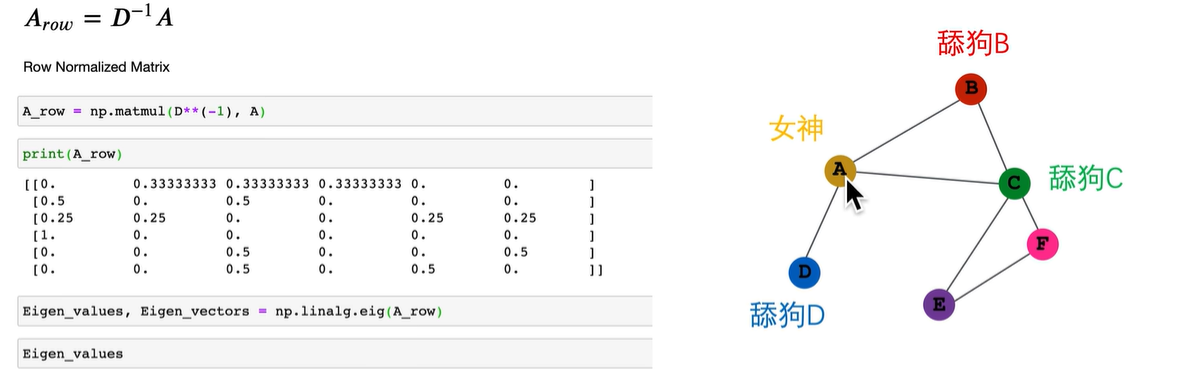

- 此处H矩阵左乘一个A阵做的事实际上是从H矩阵中选出与点邻接的点的嵌入,将其累加

D^-1A实际上代表的是每个邻接节点相加的权重,比如三个节点就是每个点1/3,四个就是每个点1/4

- 经过矩阵线性变换方向不变的向量就是矩阵的特征向量,幅值变化的幅度就是矩阵的特征值

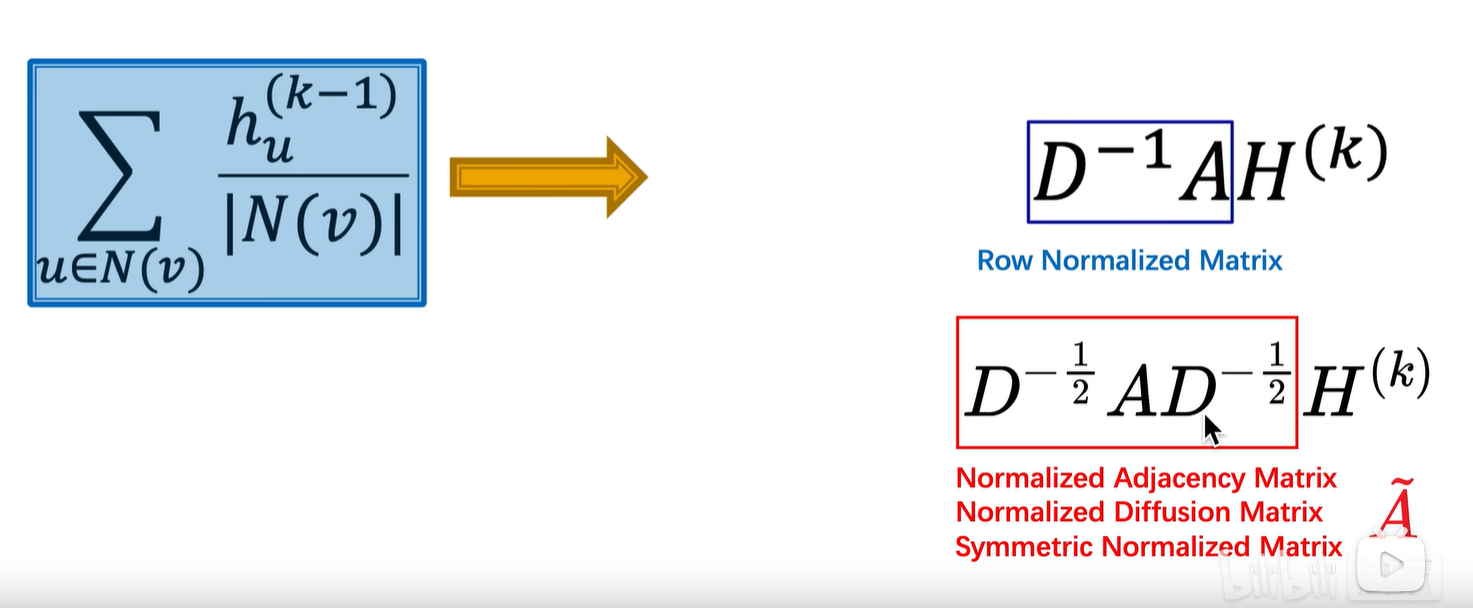

- 上述矩阵是为了保证矩阵的最大特征值恒定是1,同时考虑到一个节点的下一个节点多少,比如一个节点项链的节点多,那么与这个节点相邻的节点的权重就会下降而不是随意平均分布

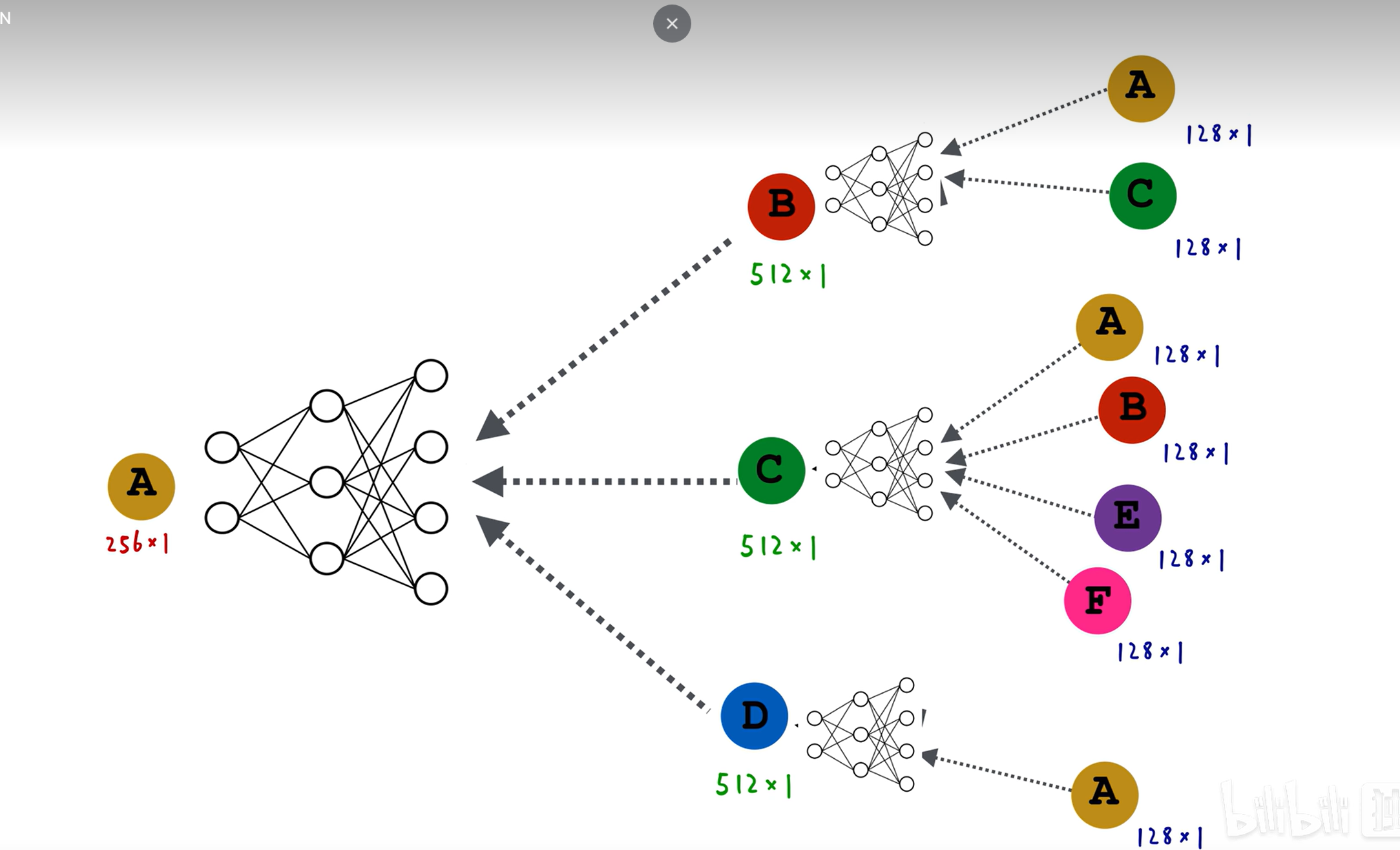

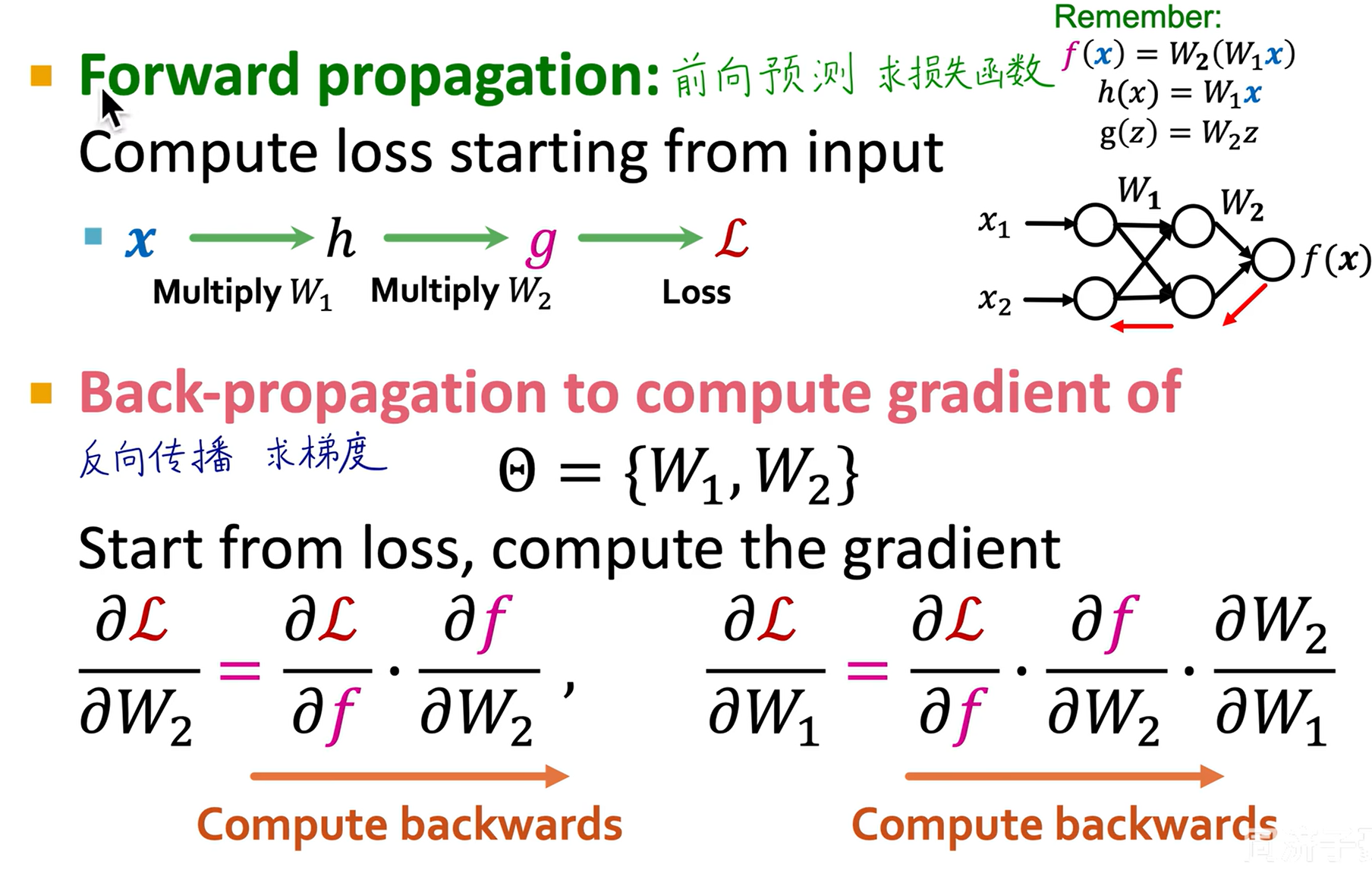

- 计算流程